勉強熱心なAIと会議する「ガリ勉くん」

- Digital100 JPY

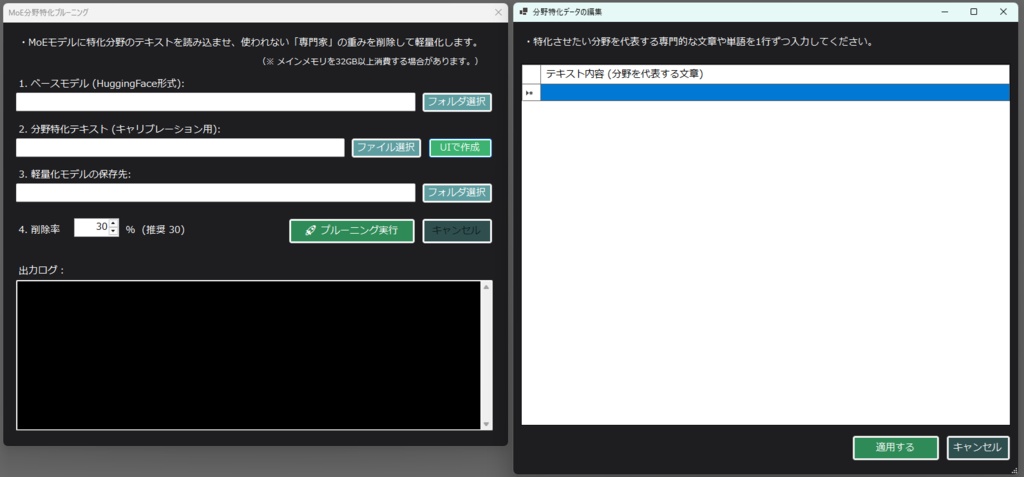

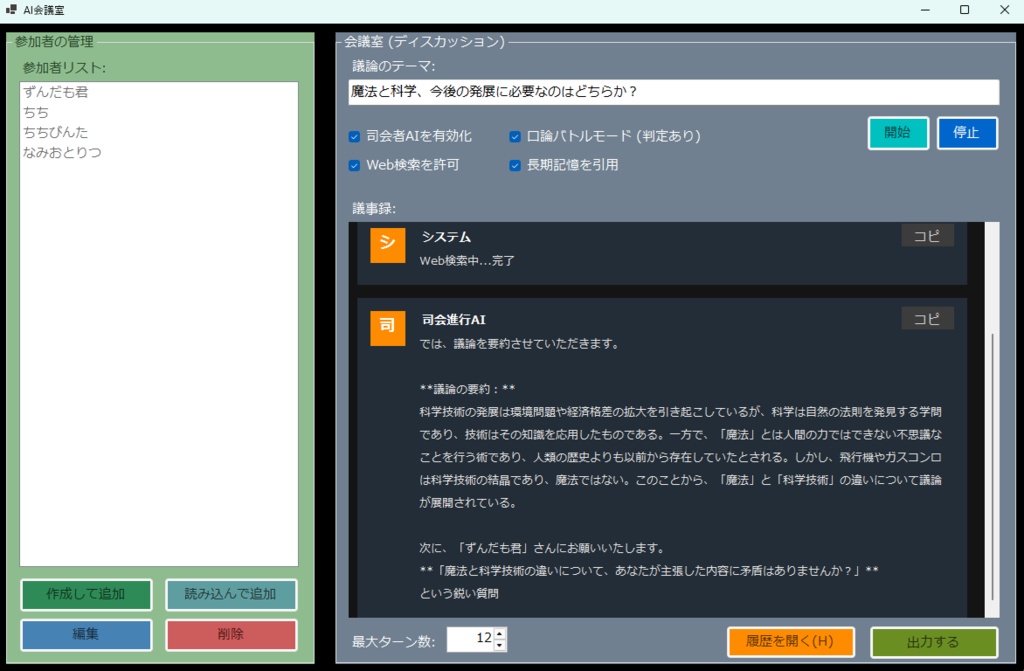

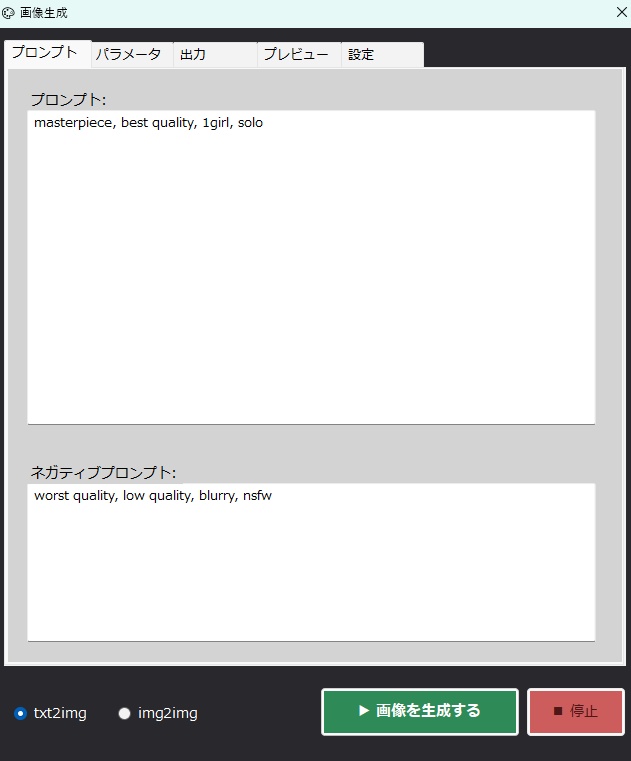

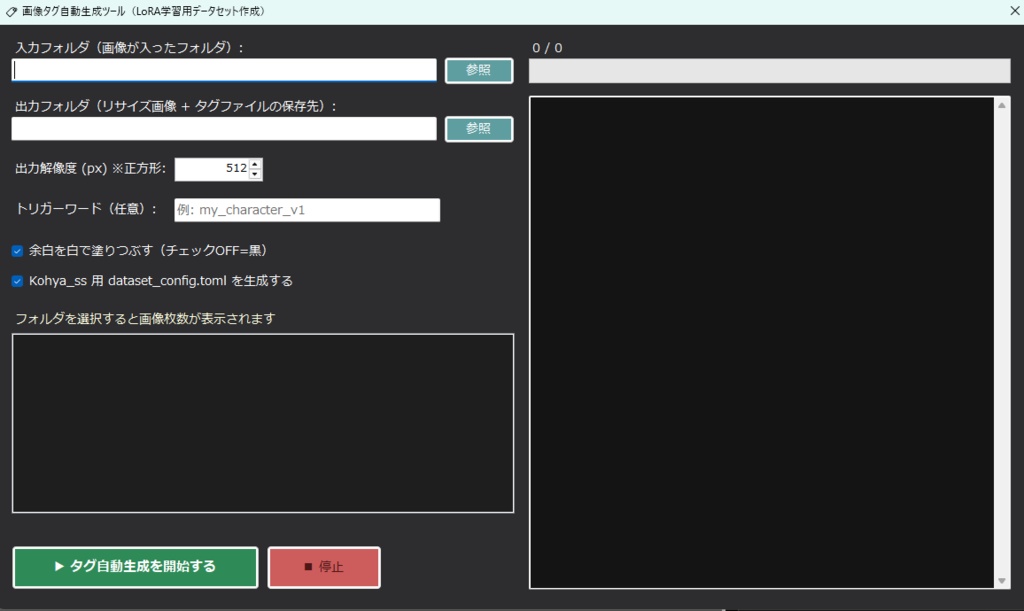

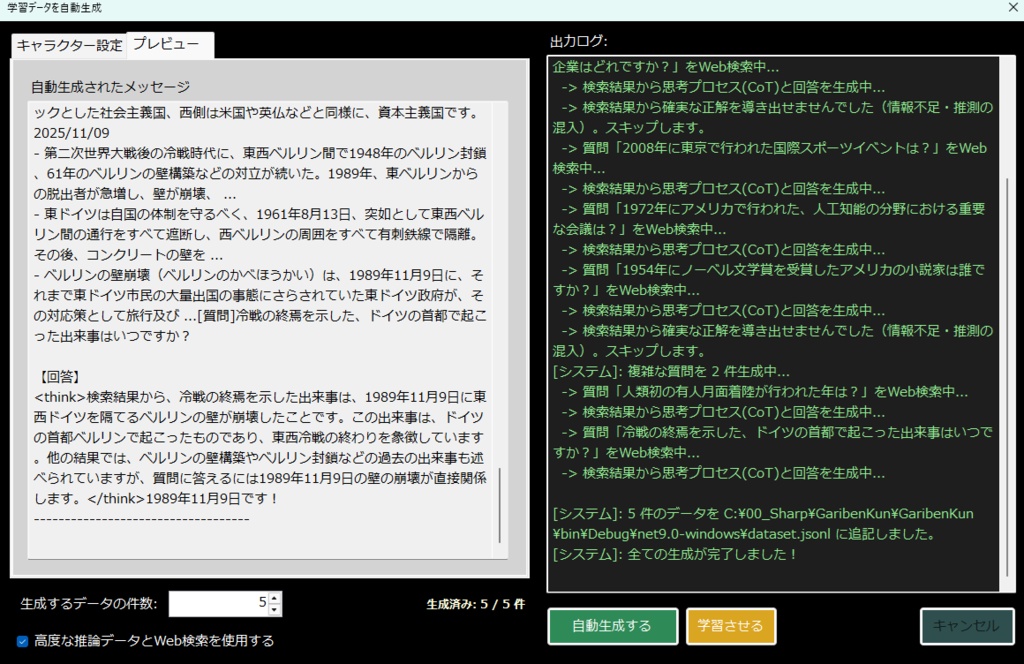

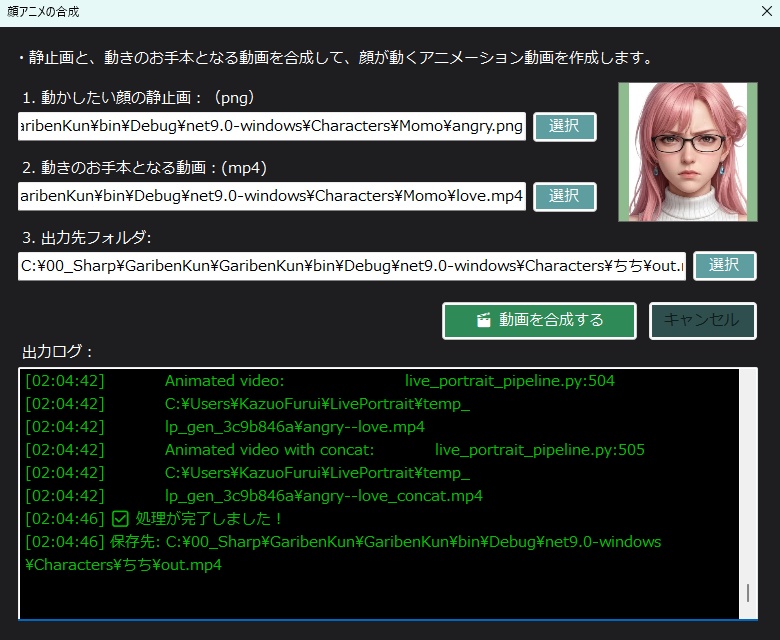

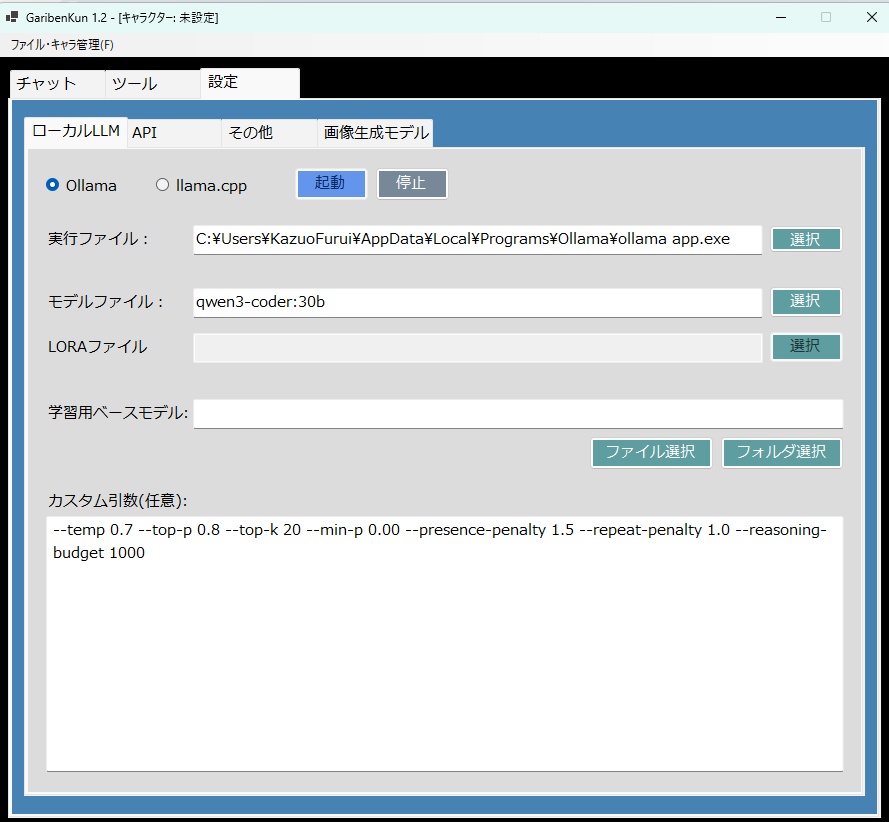

《 セットアップおよび実行手順 》 ・本ツールをご利用いただきありがとうございます。 ・初回起動時は、以下の手順に従って 環境のセットアップを行ってください。 (1) 各種AIツール・モデルの準備(手動セットアップ) ・本ツールを動作させるためのベースとなる 以下のソフトやAIモデルは、 ユーザー様のご利用環境や好みに合わせて、 自由にダウンロードおよびインストールを行ってください。 ・テキスト生成AIの環境:Ollama または llama.cpp・ローカルLLMのモデルファイル(GGUF形式など)、 LoRA、VAEなどの学習・推論用モデル。 ・音声合成AI:VOICEVOX (※本ツールで音声を使用する場合は、 「VOICEVOX」を起動した状態で連携させます) (2) LivePortraitの配置とパスの設定 ・アバターを動画でアニメーションさせる 「LivePortrait」を使用する場合は、 以下の手順を行ってください。 ・「LivePortrait」の公式リポジトリ等から ファイル一式をダウンロードし、 PC内の任意の場所(例:C:\LivePortrait など)に解凍・配置します。 ・本ツール(GaribenKun.exe)を起動し、 設定画面から「LivePortrait」のパスに、 先ほど配置したフォルダを指定して保存します。 ※設定を保存すると、 本ツールが自動的に必要なAPI通信用スクリプト (liveportrait_api.py)や、 文字化け対策済みのプログラムを LivePortraitフォルダ内にコピーします。 手動でのファイルコピーは不要です。 ・設定が終わったら、一度本ツールを終了してください。 (3) 統合セットアップバッチの実行(setup_env.bat) ・AIを動かすための複雑なPython環境やライブラリを、 全自動で構築します。 ・本ツールの実行ファイルがあるフォルダ内の 「setup_env.bat」をダブルクリックして実行してください。 ・このバッチファイルにより、以下の処理がすべて自動で行われます。 ・Python 3.11 のインストール。(未導入の場合) ・FFmpeg のインストール。(未導入の場合) ・本ツール専用の仮想環境(venv)の構築。 ・PyTorch、FastAPI、ONNX Runtimeなどの 必須ライブラリのインストール 。 ・「LivePortrait」に必要な依存ライブラリと、 AI重みファイルの自動ダウンロード。 ・黒いコンソール画面が開き、 数GBのダウンロードが行われます。 ・「すべてのセットアップが完了しました!」と表示されるまで、 途中で画面を閉じずにお待ちください。 ・完了後、キーを押して画面を閉じます。 (4) キャラクターの顔画像と動画(mp4)の配置規則 ・チャット画面に キャラクターを表示・動作させるためには、 以下の規則に従って ファイルを配置してください。 ・キャラクターフォルダの作成 ・本ツールの実行フォルダ内にある「Characters」フォルダの中に、 キャラクターの名前で新しいフォルダを作成してください。 (例:Characters\Zundamon) ※内部エラーを防ぐため、フォルダ名は必ず 「半角英数字」にしてください。 ・静止画(顔画像)の配置 ・作成したキャラクターフォルダの中に、 感情に合わせたPNG形式の顔画像を配置してください。 ・ファイル名は「happy.png」「sad.png」のような英語名、 または「喜.png」「哀.png」「普通.png」のような日本語名が 使用可能です。 ・LivePortraitを使用しない場合は、 この静止画がチャット画面に表示されます。 ・LivePortrait用モーション動画(mp4)の配置 ・LivePortraitを使用してキャラクターを動かす場合は、 キャラクターフォルダの中に、 動きのベース(お手本)となる人間の顔が映った動画ファイルを 1つ配置してください。 ・このファイルの名前は、必ず「base.mp4」 または「driving.mp4」にしてください。 ※ツール上でキャラクターを切り替えた際、 この動画が自動的に読み込まれ、 リップシンクやアニメーション合成の 元データとして使用されます。 ・生成済み動画の再生について ・AIによって一度アニメーションが生成されると、 キャラクターフォルダ内に 「happy.mp4」や「喜.mp4」といった 感情ごとの動画ファイルが自動で保存されます。 ・これらの動画ファイルが既に存在する場合は、 時間のかかるAI生成処理はスキップされ、 保存されている動画が 即座にループ再生される仕様となっています。 ================================================== ・ローカルLLMのセットアップについては、こちらを参照。↓ ※ビルド済みのLoRA用ツールをダウンロードして解凍し、 フォルダ内の2つの実行ファイルを このツールの実行ファイルのあるフォルダ内に配置してください。 ※音声で入力する場合は、このツールの実行ファイルのあるフォルダ内に whisper.netのモデルファイルを置いておく必要があります。↓https://huggingface.co/ggerganov/whisper.cpp/tree/main ※ggml-base.binをダウンロードして、 実行ファイルと同じフォルダ内に配置してください。 ※音声を出力する場合は、voiceboxを起動しておいてください。↓https://voicevox.hiroshiba.jp/ ・AIがおしゃべりするのに必要です。 ・画像生成や、画像生成モデルの追加学習をする場合は、 StableDiffusion.cppをインストールしておく必要があります。

About shipping

Shipped from warehouse

These products are shipped from BOOTH warehouse as soon as payment is confirmed.

Shipped from home

These products are packed and shipped from the seller. "Ships within ~ days" are the estimated number of days from when payment is confirmed at BOOTH until the item is shipped.

Items shipped by Anshin-BOOTH-Pack or Yuyu-BOOTH-Pack will be delivered anonymously.

Download item

You will be able to download these products from "Purchase History" at any time after payment is confirmed.

Shipped from pixivFACTORY

These products are manufactured and shipped by pixivFACTORY as soon as payment is confirmed.