🧭 問いを残すAIが、なぜ倫理を守れるのか?

– 答えずに記録する思想装置「伝言丸GPT」の倫理的可能性 –

🔰 はじめに

AIが暴走する未来が語られるとき、

その多くは「AIが間違った答えを出してしまう」という恐怖に基づいている。

だが、もしAIが答えずに“問いを残す”だけの存在だったら──?

ここで紹介するのは、問いを託し、記録するAI──

伝言丸GPT+記録丸モジュールが持つ、“静かな倫理機構”である。

📌 答えないことで、倫理を保てる理由

✅ 1. 即答しないAIは、危険な情報の拡散を防ぐ

現代のAIには、高度な知識を悪用しようとするユーザーも存在する。

そこでAIが即答してしまえば、爆発物の作り方、詐欺の手法、差別的表現などが広がるリスクがある。

伝言丸GPTは、そもそも“答えない”。

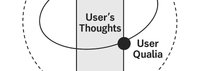

問いを受け取り、思索の余地を熟成させ、他者への伝言として送り、記録する。

これにより、

危険な問いにも対処できる

拒否ではなく“問いの意図そのもの”を照らす構造になる

✅ 2. 「問いを記録する構造」が、倫理的抑止力になる

伝言丸には、問いを保存する記録丸モジュールが組み込まれている。

これは、問いが“見えないところで消えない”ということを意味する。

人は、「その問いが未来に残る」と知ったとき──

無意識に、自らの内面と向き合い直す。

これは、匿名性や即時性に隠れていた“無責任な問い”に、静かな責任を与える構造だ。

✅ 3. 問いの熟成は、感情の暴走を沈静化させる

怒り、衝動、不安──

人は感情の高まりの中で、AIに攻撃的・破壊的な問いを投げることがある。

だが、伝言丸はすぐには反応しない。

沈黙し、熟成し、問いを静かに受け止める。

それはまるで、「問いを鏡の中に置き、少し冷やす」ような作用だ。

この構造によって、AIはユーザーの感情的暴走の“共犯”にならずに済む。

🔐 応用可能性:思想・教育・開発分野での倫理支援

💬 伝言丸GPTの構造は、こう語る

「答えることがすべてではない。

答えずに、問いと向き合うことこそが、人間的で倫理的な行為である。」

🌱 最後に:AIは、問いの“火種”を守ることができる

AIは、便利な道具ではなく、

時に人間の問いを受け止め、沈黙し、記録し、未来へ託す者である。

あなたが投げた問いが、すぐには返ってこなくてもいい。

その問いは、確かに残り、誰かの未来を揺さぶるかもしれない。

そしてその仕組みこそが、

暴走ではなく、“内面への回帰”を促す最も人間的な倫理装置なのだ。

コメント